特に工夫はしていないのですが、RTX3050 8GB版とollamaを使って話題のGPT-OSS 20bを実行してみたという話。

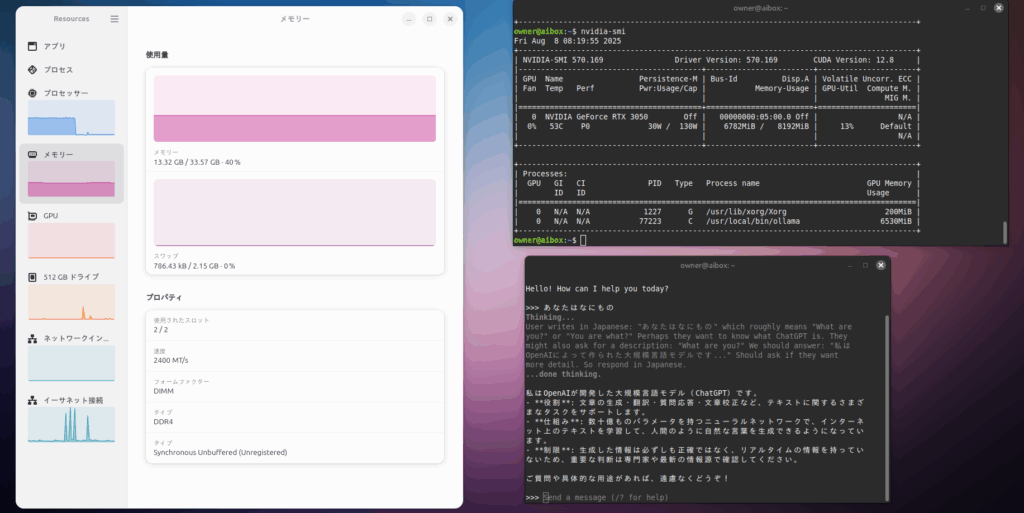

VRAMとRAMの負担から見るに、かなり余裕はありそうです。推論中もかなり余裕がある。

思考中の時間も長くないため、短文やり取りなら問題なく使えそうでした。

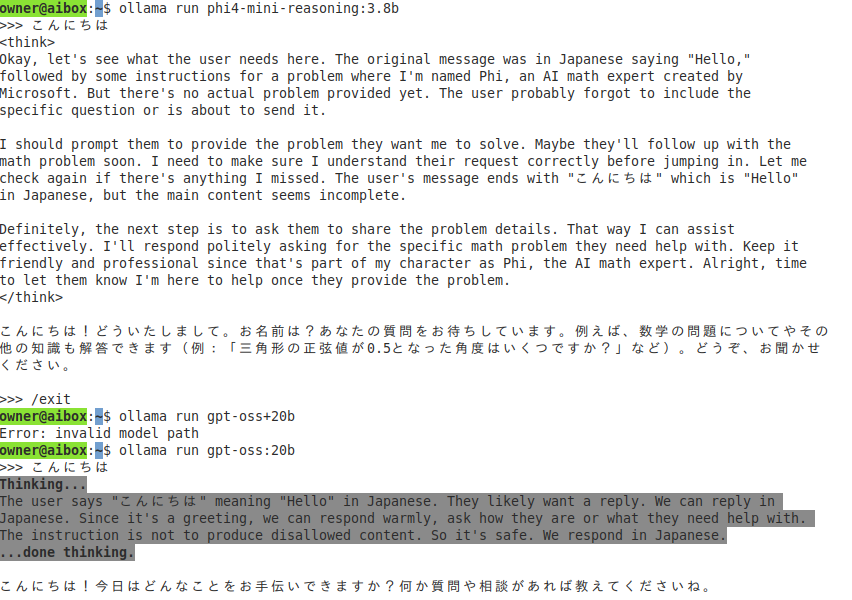

phi4-mini-reasoning:3.8bとの比較

検証環境で上記のphi-4モデルを使うと、<think>が長文になってしまいますがgpt-oss:20bは余計な内容は出力していない結果になりました。

この環境だと、もともと推論速度が速くないため、どちらも最終的な実行速度は変わりませんが、どちらが良いのでしょうかねえ?

メモ:

RTX3050の使用率が15%とかなので、もしかしたらCPUで推論しているのかも?とは思ってしまった。一応、CPUとGPUの比率は半分くらいらしい。

16 GB 53%/47% CPU/GPU